网站首页互联网 >正文

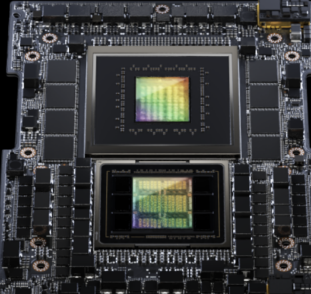

随着生成式人工智能技术的兴起,Nvidia的股价在2023年出现了爆炸式增长。该公司希望通过推出最新的GraceHopper超级芯片来增强其在服务器市场的势头,该芯片是世界上第一个采用最新HBM3e内存的芯片。

Nvidia推出了最新的GraceHopper超级芯片,旨在为数据中心提供支持,为生成式人工智能或其他加速计算提供支持。尽管Nvidia继续以不同形式为消费者生产基于Arm的芯片,但几年前它转向优先考虑基于Arm的服务器SoC,通过将其GraceHopper平台与其服务器级GPU集成,可以进一步加速这些SoC。随着包括ChatGPT和Midjourney在内的生成式人工智能技术的兴起,该公司的赌注得到了巨大的回报,自今年年初以来,该公司的股价飙升了约200%。

与最初的GraceHopper超级芯片一样,采用双配置的新型GH200最多可容纳144个ArmV系列Neoverse内核。与之前一样,CPU(Grace)与Nvidia的H100TensorCoreGPU(Hopper)配对。H100GPU可以提供至少51teraflops的FP32计算能力,与组合的GH200架构可实现令人印象深刻的8petaflops的AI性能。

为了使GH200达到这些新的性能水平,尽管保持芯片架构不变,Nvidia仍使用282GB的最新HBM3e内存升级了内存架构。HBM3e比常规HBM3内存快50%,总带宽为10TB/秒。这使得GH200能够处理比第一代芯片大3.5倍的模型,并使其成为世界上第一个配备HBM3e内存的芯片。

Nvidia还表示,GraceHopper平台具有可扩展性,支持使用Nvidia的NVLink互连连接额外的GraceHopper芯片。一致性内存(集群中所有CPU和GPU共享)最高可达1.2TB。Nvidia表示,领先的服务器制造商预计将在2024年第二季度交付运行GH200配置的系统,涵盖100多种服务器版本。

版权说明:本站所有作品图文均由用户自行上传分享,仅供网友学习交流。若您的权利被侵害,请联系我们

相关文章:

- 2023-08-14ThinkPadL14Gen4廉价笔记本电脑中的AMDRyzen7030很烦人

- 2023-08-14JabraElite10和8ANC耳机配色和音频规格泄露

- 2023-08-13北京国安vs天津权健,北京国安 vs 天津泰达比分结果和历史战绩

- 2023-08-13ac米兰vs尤文图斯直播视频,曼联vs AC米兰比分结果和历史战绩

- 2023-08-132016中超联赛鲁能与天津泰达,山东鲁能 vs 天津泰达比分结果和历史战绩

- 2023-08-134TBCrucialX6便携式SSD现亚马逊60%折扣

- 2023-08-13谷歌Pixel8Pro智能手机泄露的宣传视频中详细介绍了新的蓝色选项和音频魔术橡皮擦

- 2023-08-13海信PX2Pro新型超短焦投影仪在多个市场开放预订

- 2023-08-12梅德梅尔,德梅尔什么水平及个人信息

- 站长推荐

- 栏目推荐

- ThinkPadL14Gen4廉价笔记本电脑中的AMDRyzen7030很烦人

- 研究人员在加利福尼亚州发现了一群新的濒危灰狼

- μ子g-2实验结果代表了迄今为止世界上对μ子反常磁矩最精确的测量

- 研究证明量子简并气体中的多体化学反应

- 研究人员发现了135个与色素沉着相关的新黑色素基因

- 纽卡斯尔5-1阿斯顿维拉喜鹊击败维拉的球员评分

- 4TBCrucialX6便携式SSD现亚马逊60%折扣

- AppleA17Bionic首次在Geekbench跑分中表现出色与QualcommSnapdragon8Gen3相比,性能提升高达47%

- Lactalis收购加拿大甜点制造商MarieMorin

- 加州复苏的图莱里湖发现禽类肉毒杆菌中毒引发对候鸟的担忧